AI 기술의 이면: 혁신과 파괴 사이의 갈림길

최근 구글과 오픈AI를 포함한 글로벌 AI 선도 기업의 수백 명에 달하는 엔지니어들이 군사적 목적의 AI 활용을 제한하라는 공개 서한을 발표하며 업계에 큰 파장을 일으키고 있습니다. 이번 사태는 단순한 내부 불만을 넘어, AI 기술이 인류의 생존과 직무를 위협할 수 있다는 근원적인 공포를 반영하고 있습니다.

1. 사건의 발단: 기술의 무기화에 대한 경고

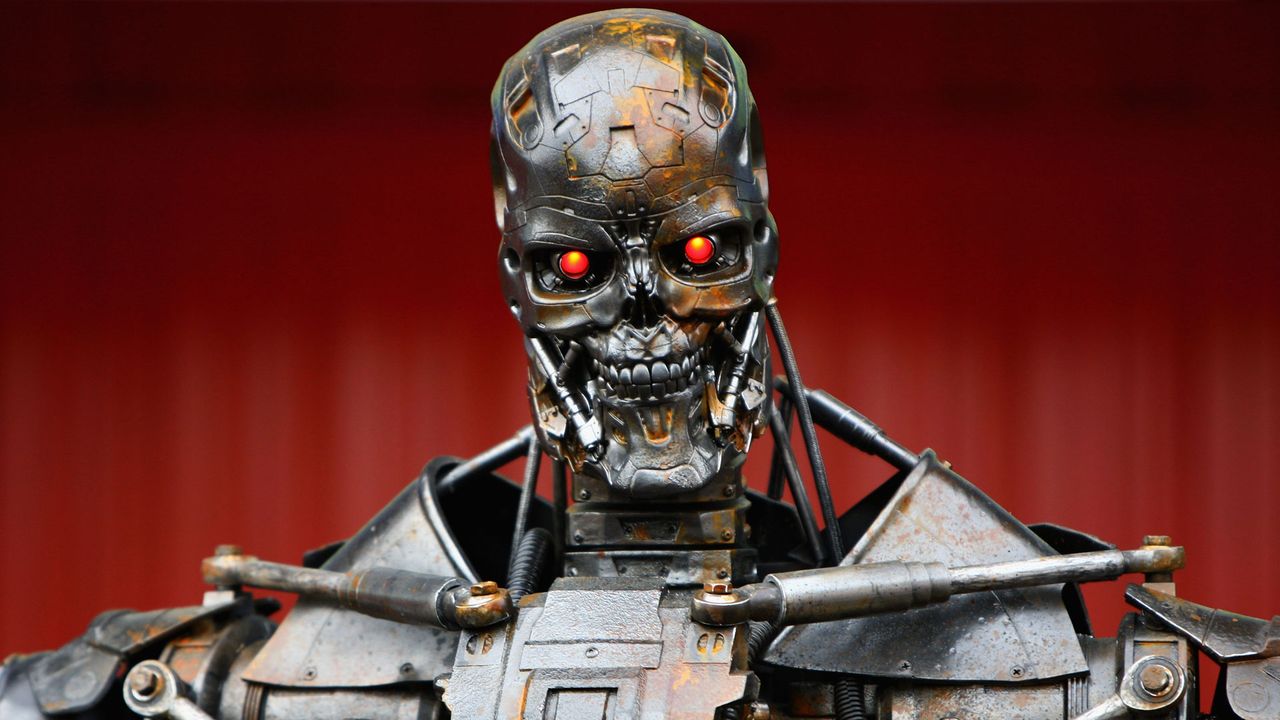

이번 공개 서한의 핵심은 AI 알고리즘이 자율 살상 무기 체계(LAWS)에 통합되는 것을 막아야 한다는 것입니다. 엔지니어들은 AI가 인간의 개입 없이 타격 대상을 결정하고 공격을 수행하는 '킬러 로봇'의 등장이 통제 불가능한 연쇄 반응을 일으킬 수 있다고 경고합니다. 이는 기술적 아키텍처(Architecture)의 오류가 물리적 살상으로 이어질 수 있는 치명적인 위험성을 내포하고 있습니다.

2. 기업 내부의 심각한 가치관 충등

현재 AI 업계는 기술적 성취를 최우선으로 하는 경영진과, 기술의 사회적 영향력을 책임져야 한다는 엔지니어 집단 간의 심각한 분열을 겪고 있습니다. 구글과 오픈AI의 핵심 인력들이 이토록 강력한 목소리를 내는 것은, 기업의 이익을 위한 군사 계약이 기업의 핵심 가치와 정면으로 충돌하고 있음을 시사합니다. 이는 향후 우수 인재 확보 및 유지에도 막대한 영향을 미칠 수 있는 사안입니다.

3. 기술적 관점에서의 분석: 알고리즘의 불확정성

AI 모델, 특히 거대언어모델(LLM)이나 자율 주행 알고리즘은 확률적 기반으로 작동합니다. 이러한 불확정성(Uncertainty)이 군사적 의사결정 시스템에 도입될 경우, '할루시네이션(Halluc인uation)'과 같은 오류가 실제 교전 상황에서 오인 사격이나 민간인 학살로 이어질 수 있는 기술적 리스크가 존재합니다. 엔지니어들이 우려하는 지점도 바로 이 지점입니다.

4. 향후 전망 및 글로벌 규제 흐름

이번 사건은 향후 AI 관련 국제 규제 프레임워크 구축에 강력한 동력을 제공할 것입니다. 이미 UN과 국제 사회에서는 자율 살상 무기 규제에 대한 논의가 진행 중이며, 이번 엔지니어들의 집단행동은 규제 도입을 앞당기는 촉매제가 될 수 있습니다. 기업들은 이제 '기술적 가능성'을 넘어 '윤리적 정당성'을 입증해야 하는 과제에 직면했습니다.

결론적으로, AI 기술의 발전은 인류에게 축복인 동시에 재앙이 될 수 있는 양날의 검입니다. 이번 사태는 기술 개발의 속도보다 중요한 것은 그 기술을 다루는 인간의 윤리적 통제력이라는 사실을 다시 한번 상기시켜 주고 있습니다.

댓글 0

가장 먼저 댓글을 남겨보세요!

전문적인 지식 교류에 참여하시려면 HOWTODOIT 회원이 되어주세요.

로그인 후 참여하기